SEO-аудит сайта — это комплекс мер, позволяющий выявить ошибки сайта, которые необходимо устранить для лучшего продвижения сайта, или же, наоборот, убедиться в том, что с вашим сайтом все хорошо.

SEO аудит сайта включает в себя:

- Анализ данных из Яндекс.Вебмастер, Google Search Console

- Технический аудит сайта

- Аудит содержания

Анализ данных из Яндекс.Вебмастер, Google Search Console

Google Search Console и Яндекс.Вебмастер – это инструменты, которые помогут понять как поисковые системы относятся к сайту.

Яндекс.Вебмастер

Страницы в поиске

Индексирование → Страницы в поиске

В нем находится информация о страницах, которые участвуют или же не участвуют в поиске Яндекса.

С помощью информации из данного раздела вы сможете:

- следить за изменением количества страниц в поисковой выдаче Яндекса и за соотношением числа добавленных и исключенных страниц;

- получать информацию о дате последнего посещения сайта роботом и обновления поисковой выдачи;

- выяснить причину исключения страницы из результатов поиска.

Структура сайта

Индексирование → Структура сайта

Здесь показаны разделы сайта, которые содержат не менее 10 страниц и составляют более 1% от общего числа страниц, загруженных в базу Поиска. Разделы представлены в виде дерева в соответствии со структурой URL сайта. По каждому разделу сайта доступна информация о количестве страниц, которые были загружены роботом Яндекса и участвуют в поиске.

Представленные данные помогут определить, что робот загружает именно те разделы сайта, которые вы считаете интересными для пользователей.

Получите бесплатно стратегию в которой мы:

- Проведем всесторонний аудит вашего сайта

- Покажем точки роста

- Составим прогноз роста трафика и лидов

Статистика обхода

Индексирование → Статистика обхода

Индексирующий робот Яндекса регулярно обходит страницы сайтов и загружает их в поисковую базу. При этом робот может загрузить не все нужные вам страницы из-за их недоступности.

На данной странице можно узнать, какие страницы вашего сайта обходит робот и выявить адреса страниц, которые робот не смог загрузить из-за недоступности сервера, на котором находится сайт, или из-за ошибок в содержимом самих страниц.

Региональность

Информация о сайте → Региональность

Яндекс уделяет большое внимание учету региональности в результатах поиска. Вводя в поисковую строку геозависимый запрос, пользователь предпочитает увидеть ответы из своего региона, а не из других городов.

Соответственно, для того, чтобы ваш сайт ранжировался в нужном вам регионе (городе, области и т.д.) необходимо это указать.

Для начала надо понимать какой у вас тип сайта: информационный или предлагающий услуги, товары — и на основании этого зависит нужно ли вам указывать региональность сайта.

Информационный общей тематики. В данном случае региональность не обязательна.

Информационный сайт региональной тематики (например, региональный портал). Необходимо указать региональность. Выполнить следующие шаги:

- Убедитесь, что на сайте правильно размещены контактная информация и данные о региональной принадлежности.

- Укажите предпочтительный регион в интерфейсе Яндекс.Вебмастера (если не был указан).

Сайт, предлагающий услуги или товары. Также необходимо указать региональность. Выполнить следующие шаги:

- Убедитесь, что на сайте правильно размещены контактная информация и данные о региональной принадлежности.

- Укажите предпочтительный регион в интерфейсе Яндекс.Вебмастера (если не был указан).

- Добавьте сайт в Яндекс.Справочник (если не был добавлен ранее).

Основываясь на информации выше, вы сможете понять правильно ли у вас указан региональность сайта и нужна ли он вообще.

Безопасность и нарушения

Диагностика → Безопасность и нарушения

В данном разделе отображаются нарушения и угрозы, найденные на сайте.

Проверяем на наличие. Если раздел пуст — все ок.

Google Search Console

Эффективность

Отчет об эффективности содержит различные показатели, связанные с эффективностью сайта в результатах поиска Google (частоте нахождения по запросам, средней позиции, CTR и т. д.), а также сведения по специальным функциям (например, расширенным результатам). Этот отчет позволит:

- выяснить, как поисковый трафик меняется со временем, откуда приходят посетители и по каким запросам показывается ваш сайт;

- узнать, у каких страниц наибольший и наименьший CTR в результатах Google Поиска.

Покрытие

В данном разделе отображаются страницы с ошибками, страницы с предупреждениями и исключенные страницы.

Если ваши нужные страницы относятся к одной из вышеперечисленных категорий, то необходимо провести повторную проверку, т.к. иногда данные могут быть неактуальными. Если же опасения подтвердились, то необходимо применить соответствующие меры.

Меры, принятые вручную

«Проблемы безопасности» — на данные отчеты обращаем внимание в первую очередь. Если у вас есть проблемы с этими пунктами, то, вероятнее всего, они являются (или будут являться) первопричиной низких позиций и упадки трафика.

Технический аудит

Он состоит из проверки технической стороны сайта: дубли страниц, дубли мета-тегов, валидация html-кода, анализ скорости загрузки страниц, адаптивность для мобильных устройств и т.д

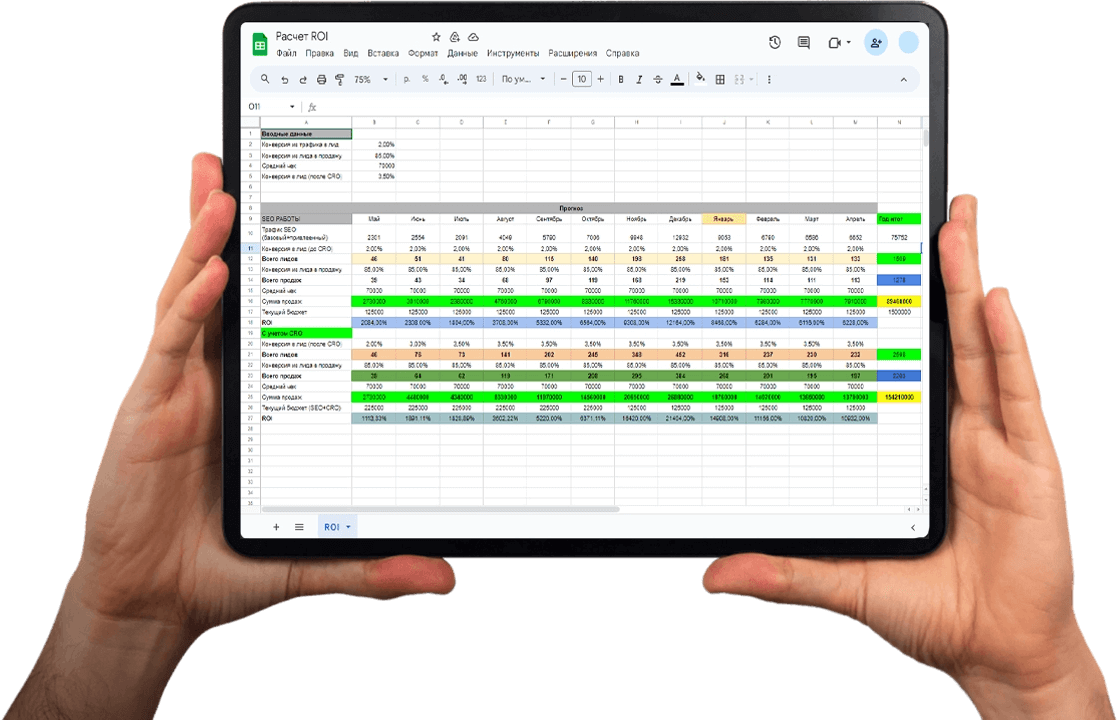

Прозрачно покажем на сколько вы сможете увеличить продажи с сайта

- Проведем всесторонний аудит вашего сайт

- На основе аудита составим прогноз по трафику, конверсии, лидам и продажам

- Покажем прогнозные сроки окупаемости

Проверка на наличие ссылок с неверными кодами ответа сервера

В идеале все страницы сайта должны отдавать 200 код ответа сервера. Для полноценного анализа лучше использовать приложение Screaming Frog SEO Spider или Netpeak Spider.

Данные инструменты позволяют выявить страницы сайта с 3хх, 4хх и 5хх кодами ответа сервера.

- 3хх. Зачастую это ссылки с 301 и 302 кодами ответа сервера. Их необходимо исправить на прямые, если это сделано непреднамеренно.

То есть, к примеру раньше у вас была страница /auto/, но вы создали новую — /cars/ и со страницы /auto/ вы настроили 301 редирект на страницу /cars/.

Но на сайте у вас до сих пор стоят ссылки на старую страницу /auto/. Переходя по этой ссылке робота и пользователя сервер перенаправляет на новую страницу (/cars/).

Заменив старую ссылку на новую мы избавимся от ненужного 301 редиректа, что в свою очередь благотворно влияет на краулинговый бюджет и сокращает время ожидания пользователя. - 4хх. В основном это страницы с 404 и 403 кодами ответа сервера. 404 — говорят, что страница не существует. 403 — доступ запрещен.

Необходимо проверить к нужным ли страницам запрещен доступ и для нужных ли страниц сервер отдает 404.

404 исправляем путем удаления ссылок с сайта. - 5хх. Ошибки, возникшие по вине сервера. Стоит изучить код ответа сервера и принять меры.

HTTPS-протокол

Если вы храните, обрабатываете персональные данные, то необходимо позаботиться о приобретении и установке SSL-сертификата.

Соответственно, надо все страницы перевести на защищенный протокол с помощью 301 редиректа.

Дубли страниц

Склейка

Смотрим доступен ли сайт с www и без www — должна открываться одна и та же страница в обоих случаях. Если этого не происходит, то необходимо настроить 301 редирект.

Дубли мета-тегов

В первую очередь необходимо выявить страницы с одинаковыми title. Это можно сделать с помощью инструментов: Netpeak Spider и Screaming Frog SEO Spider.

Вводите адрес сайта и запускаете анализ. Далее смотрите отчет по дублям title.

Если страницы с одинаковыми title являются дублями (контент идентичен), то необходимо настроить 301 редирект, либо canonical.

Если же контент отличается, то необходимо уникализировать title этих страниц. Например, на одной странице у вас представлены автокресла, а на другой — коляски, при этом title у них одинаковый, пусть будет: “Интернет-магазин Блублу”. Title должен отражать суть страницы. Тогда пусть title будут выглядеть следующим образом:

- Купить коляски в интернет-магазине Блублу

- Автокресла — купить в интернет-магазине Блублу

404 страница

Если пользователь попал на несуществующую страницу, то необходимо это отображать путем информирования и возможностью вернуться на главную или на другую страницу из меню.

В мета-тегах и h1 должна быть соответствующая информация.

Страница должна отдавать 404 код ответа сервера. Проверить можно здесь.

robots.txt

Необходимо убедиться:

- В наличии данного файла в корне сайта. Должен открываться по адресу: site.ru/robots.txt.

- В корректном заполнении. Валидатор есть в панели Яндекс.Вебмастер (Инструменты → Анализ robots.txt).

- Что нужные страницы доступны к индексации. Добавьте в валидатор несколько типовых страниц и нажмите “Проверить”.

Если страница не заблокирована в robots.txt, то увидите зеленую галочку.

Если страница заблокирована, то увидите красное правило, которое блокирует данную страницу. - Что ненужные страницы запрещены к индексации. Обычно такими являются сервисные страницы: корзина, сравнение, вход, регистрация и т.д.

- Что есть ссылка на карту сайта — sitemap.xml.

Примечание. robots.txt не является строгим правилом, поэтому некоторые страницы, заблокированные в нем, могут все равно участвовать в поиске.

Если вы хотите строго запретить добавлять в индекс определенные страницы, то необходимо разместить на них мета-тег robots — <meta name=”robots” content=”noindex”>, либо с помощью http-заголовка X-Robots-Tag со значением noindex или none.

Sitemap.xml

- Проверить наличие файла. Если файла нет — создать. Если присутствует, то проверяем какие страницы находятся в нем.

- Обязательно должны присутствовать все страницы, которые являются важными.

- Проверить коды ответа страниц. Должны быть только страницы с 200 кодом ответа сервера.

- Проверить файл с помощью валидатора в Яндекс.Вебмастере (Инструменты → Анализ файлов Sitemap).

Оптимизация для мобильных устройств (Mobile-friendly)

Доля пользователей, посещающих сайты с мобильных устройств, уже выше, чем доля посетителей с десктопов. Поэтому необходимо убедиться, что ваш сайт оптимизирован под мобильные устройства.

Проверяем несколько типовых страниц и смотрим на результат.

Если будут какие-либо ошибки, то инструмент укажет на них и даст рекомендации по их устранению.

Удобство для мобильных

В Google Search Console есть отчет “Удобство для мобильных”.

Если присутствуют ошибки, то увидите их в соответствующем столбце.

Кликнув на отчет, внутри найдете анкор “Подробнее”, при клике на который вы попадете на страницу с рекомендациями устранения соответствующей проблемы.

Доступность ресурсов сайта для поисковых роботов

При загрузке страницы у робота Google могут возникнуть сложности с обработкой ресурсов сайта.

Для того, чтобы убедиться, что ваш сайт корректно обрабатывается краулером Google необходимо провести следующие тесты:

Чтобы увидеть заблокированные ресурсы необходимо нажать на кнопку “Подробнее” (см. скриншот).

Основная причина недоступности ресурсов это их блокировка в файле robots.txt. Скорректируйте данный файл, основываясь на информации полученной из отчета.

2. Проверка URL в Google Search Console

Для проверки URL необходимо открыть отчет “Проверка URL”, добавить адрес интересующей страницы и запустить проверку.

После проверки в правом верхнем углу необходимо нажать на кнопку “Проверить на сайте”. После этого вы сможете увидеть заблокированные ресурсы.

Нажмите на “Изучить проверенную страницу”. В правой стороне экрана появится блок с тремя вкладками: HTML, Скриншот, Подробнее.

Переходим на вкладку “Подробнее” и смотрим с загрузкой каких ресурсов возникают трудности.

Так же, как и в пункте выше, основная проблема — это блокировка ресурсов в robots.txt. Корректируем данный файл с учетом полученной информации.

Валидность HTML-кода

С помощью данной процедуры можно узнать соответствует ли код ваших страниц общепринятым стандартам. Если да, то поисковые роботы без труда смогут понять что из себя представляем ваш сайт.

Если нет — необходимо исправить ошибки.

Проверку лучше производить с помощью сервиса Markup Validation Service.

Расскажем как быстро увеличить продажи с сайта уже на третий месяц работ

Заполните форму, чтобы получить пошаговый план

- Разработаем персональную стратегию для вашего сайта

- Проведем в zoom разбор стратегии совместно с нашей командой

Скорость загрузки сайта

Используем инструмент Google Pagespeed Insights.

Проверяется скорость загрузки для мобильных устройствах и для десктопов. Результаты содержатся на соответствующих вкладках.

Следуя рекомендациям, необходимо улучшить показатели скорости загрузки минимум до оранжевой зоны, в идеале — до зеленой.

Примечание. Частая проблема низкой скорости загрузки в неоптимизированных изображениях. Если вы столкнулись с аналогичной проблемой, то необходимо оптимизировать все изображения сайта с помощью рекомендуемого сервиса.

Аудит содержания

Данный пункт подразумевает проверку сайта на наличие необходимых блоков/элементов, а также сравнение с конкурентами.

Рассмотрим на примере:

Интернет-магазин

Необходимо удостовериться, что вы предоставляете всю необходимую информацию пользователям. Такой информацией могут быть:

- карточки товаров с изображениями

- цены

- возможности сортировки и фильтрации по параметрам

- характеристики, описание и свойства товара

- информация о доставке и способов оплаты товара

!Всегда анализируйте ТОП по нужным вам запросам. Смотрите конкурентов. Обращайте внимание на их контент: какие страницы и фишки у них есть, какой тип контента публикуется. Прикидывайте это на свой сайт, делайте выводы. Не надо все копировать.

Сайт, предоставляющий услуги

Например, на вашем сайте представлены услуги по производству стеклянных перегородок для душа. Скорее всего пользователям будет полезно следующее:

- текст с описанием процесса и преимуществами

- возможные варианты изготовления

- указание цены

- возможные варианты фурнитуры

- возможный выбор цветов фурнитуры

- возможность оставить заявку или заказать звонок

- примеры работ

!Не забываем смотреть ТОП и анализировать конкурентов.

Неважно какой у вас сайт (коммерческий, информационный и т.д.), старайтесь делать его максимально удобным и отзывчивым для пользователей. Чем удобнее он будет, тем лучше будут поведенческие характеристики сайта. Поведенческие характеристики, в свою очередь, являются одним из факторов ранжирования.

Также не стоит забывать и про поисковые системы. Ведь если поисковые роботы не смогут понять, что находится на вашем сайте, то и ранжироваться высоко он не будет.

Итог: это не все параметры для анализа. Но для проведения самостоятельного SEO анализа сайта и выявления базовых ошибок оптимизации сайта этого будет достаточно.